概述

本文将介绍如何使用ML.NET框架中的随机梯度下降算法来预测房屋租金。我们将使用印度房屋租赁数据集,该数据集包含了约4700条房屋租赁信息,包括卧室数量、面积、位置等特征。

环境准备

安装 .NET 6.0 或更高版本

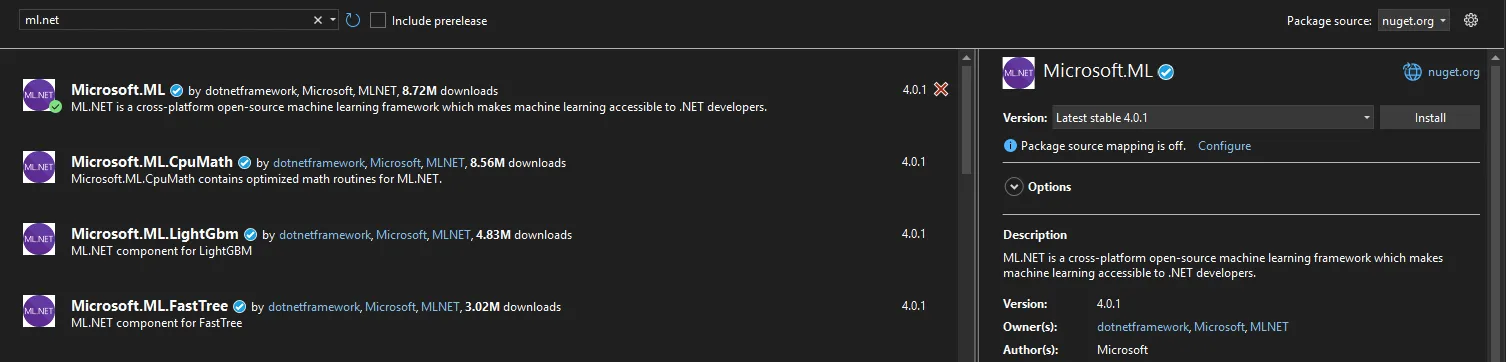

**创建控制台项目并引用 **ML.NET

textdotnet add package Microsoft.ML

数据模型定义

C#using System;

using System.Collections.Generic;

using System.Linq;

using System.Text;

using System.Threading.Tasks;

using Microsoft.ML.Data;

namespace AppHousingRent

{

public class HouseRentData

{

[LoadColumn(0)]

public float CRIM { get; set; } // 城镇人均犯罪率

[LoadColumn(1)]

public float ZN { get; set; } // 占地面积超过25000平方呎的住宅用地比例

[LoadColumn(2)]

public float INDUS { get; set; } // 城镇非零售商业用地比例

[LoadColumn(3)]

public float CHAS { get; set; } // 是否临近查尔斯河

[LoadColumn(4)]

public float NOX { get; set; } // 一氧化氮浓度

[LoadColumn(5)]

public float RM { get; set; } // 住宅平均房间数

[LoadColumn(6)]

public float AGE { get; set; } // 1940年之前建成的自用房屋比例

[LoadColumn(7)]

public float DIS { get; set; } // 到波士顿五个就业中心的加权距离

[LoadColumn(8)]

public float RAD { get; set; } // 到径向公路的可达性指数

[LoadColumn(9)]

public float TAX { get; set; } // 每10000美元的全值财产税率

[LoadColumn(10)]

public float PTRATIO { get; set; } // 城镇师生比例

[LoadColumn(11)]

public float B { get; set; } // 1000(Bk - 0.63)^2,其中Bk为城镇中黑人的比例

[LoadColumn(12)]

public float LSTAT { get; set; } // 人口中地位较低者的比例

[LoadColumn(13)]

[ColumnName("Label")] // 将MEDV标记为Label列

public float MEDV { get; set; } // 自住房的平均房价,以千美元计

}

public class HouseRentPrediction

{

[ColumnName("Score")]

public float PredictedPrice { get; set; }

}

}

本文将结合最新的 NBA 球员多赛季数据(目前已包括 2017 至 2022 赛季),使用 ML.NET 来预测球员未来的潜力与表现趋势。通过此示例,您可以了解如何在 C# 环境中加载并预处理数据、构建模型,以及评估模型的预测准确度。

前言

- 数据简介

- 包含球员多个赛季(2017 年起至 2022 年)的人口统计信息(年龄、身高、体重、出生地等)。

- 包含球队信息(效力球队、选秀年份、轮次等)。

- 包含基础篮板、得分、助攻等盒子得分(STATS)统计。

- 数据质量已在多方面做了校验,包含对 52 行缺失值的填补,来自 Basketball Reference 等可信来源。

- 注意 2022 赛季有更新,数据相对完整,且可以把近些年的球员发展趋势纳入到模型中。

- 潜力评估方向

- 通过历史场均得分、篮板、助攻等关键指标,预测下一赛季的场均表现。

- 根据年龄、体重、身高等,结合已经获得的赛季综合表现,以回归、分类或排名方式评估球员发展潜力。

以下示例将展示如何使用 ML.NET 在 C# 项目中对球员未来场均得分(Points Per Game,简称 PPG)进行回归预测。

环境准备

安装 .NET 6.0 或更高版本

**创建控制台项目并引用 **ML.NET

textdotnet add package Microsoft.ML dotnet add package Microsoft.ML.FastTree

项目概述

本文详细介绍如何使用ML.NET开发一个产品销售预测系统,实现对2024年销售量和收入的预测。该系统使用时间序列分析方法,基于历史数据进行未来销售趋势的预测。

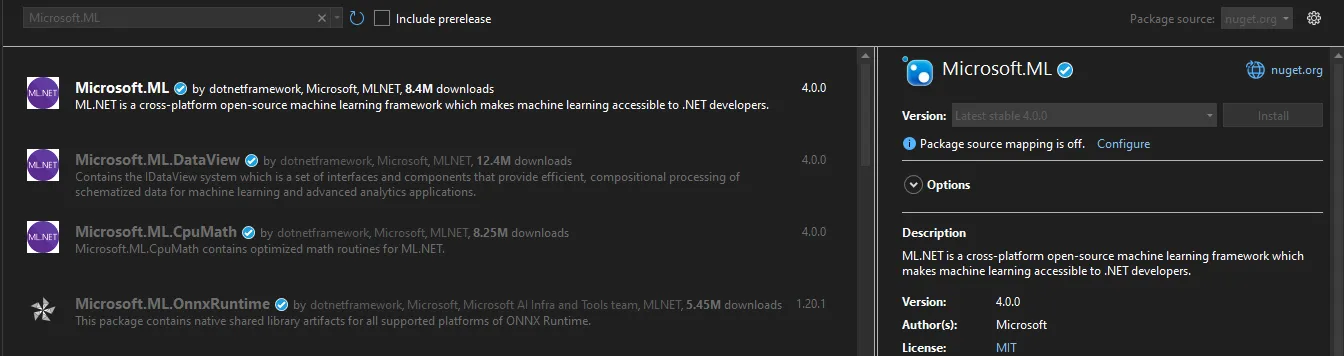

技术栈选择

- 开发语言:C# (.NET 8.0+)

- 机器学习框架:ML.NET 4.0.1

- 算法选择:SSA (Singular Spectrum Analysis) 时间序列预测

- 数据格式:CSV文件存储

系统架构设计

销售数据模型类

C#using System;

using System.Collections.Generic;

using System.Linq;

using System.Text;

using System.Threading.Tasks;

using Microsoft.ML.Data;

namespace App16

{

/// <summary>

/// 销售数据模型类

/// </summary>

public class SalesData

{

// 日期

[LoadColumn(0)]

public string Date { get; set; }

// 产品1的销售数量

[LoadColumn(1)]

public float QP1 { get; set; }

// 产品2的销售数量

[LoadColumn(2)]

public float QP2 { get; set; }

// 产品3的销售数量

[LoadColumn(3)]

public float QP3 { get; set; }

// 产品4的销售数量

[LoadColumn(4)]

public float QP4 { get; set; }

// 产品1的销售收入

[LoadColumn(5)]

public float SP1 { get; set; }

// 产品2的销售收入

[LoadColumn(6)]

public float SP2 { get; set; }

// 产品3的销售收入

[LoadColumn(7)]

public float SP3 { get; set; }

// 产品4的销售收入

[LoadColumn(8)]

public float SP4 { get; set; }

}

}

项目概述

本项目使用ML.NET构建一个预测性维护系统,通过机器学习模型预测设备故障风险。

Nuget 安装包

C#dotnet add package Microsoft.ML

SDCA(Stochastic Dual Coordinate Ascent)逻辑回归训练器

算法原理

SDCA(随机对偶坐标上升)算法

- 一种凸优化算法

- 专门用于处理大规模线性分类问题

- 计算效率高,适合高维特征数据

本教程通过一个 C# 控制台应用示例,演示如何使用 ML.NET 对时序数据进行异常检测,帮助你在销售量等关键指标发生异常变化时及时捕捉峰值和更改点。

先决条件

- Visual Studio 2022(已安装 “.NET 桌面开发” 工作负载),或者你也可以使用 VS Code、JetBrains Rider 等编辑器,只要有 .NET 开发环境即可。

- 引用ML.NET

- 安装 .NET 6 SDK 或更高版本。

- 一份产品销售数据集(例如名为 statsfinal.csv 的文件),其中包含两列:

- 日期(Date)

- 销售量(Sales)

示例数据格式如下(仅节选):

| Date | Sales |

| 13-06-2010 | 5422 |

| 14-06-2010 | 7047 |

| 15-06-2010 | 1572 |

| 16-06-2010 | 5657 |

| 17-06-2010 | 3668 |

| 18-06-2010 | 2898 |

步骤 1:创建控制台应用程序

- 打开 Visual Studio,依次选择 “创建新项目” → “控制台应用程序”。

- 选择 “.NET 6” 作为目标框架。

- 依次单击 “下一步” → “创建” 即可完成项目创建。

- 在解决方案中创建一个 “Data” 文件夹,并将前述的 statsfinal.csv 文件放置于此。